Seed3D 2.0发布,更高精度、更强可用性

Seed3D 2.0发布,更高精度、更强可用性

日期

2026-04-23

分类

模型发布

高质量且大规模的 3D 内容正成为具身智能、工业制造等领域的关键基础设施,但此前方法生成的 3D 内容在几何精度、材质真实性等方面,仍难达到生产级要求。

去年,Seed3D 1.0 探索了从单张图像到高质量 3D 模型的端到端生成,并在纹理生成方面取得突破。今天,我们正式发布更高精度的新一代 3D 生成大模型——Seed3D 2.0。团队围绕几何精度和材质质量对模型进行了架构升级,并拓展了 3D 内容的下游可用性,期望进一步推动 3D 生成迈向“生产可用”。

在与现有 3D 生成模型的对比评测中,Seed3D 2.0 在几何生成、纹理材质生成两项核心指标上均取得 SOTA 结果。模型对复杂结构的还原更加精细,PBR 材质的生成也具有更强的真实感和稳定性。

目前 Seed3D 2.0 技术报告已公开,API 也已上线火山引擎,可访问项目主页查看,欢迎体验和交流。

项目主页:

https://seed.bytedance.com/seed3d_2_0

体验入口:

火山方舟体验中心-登录-选择视觉模型-3D生成-Doubao-Seed3D-2.0

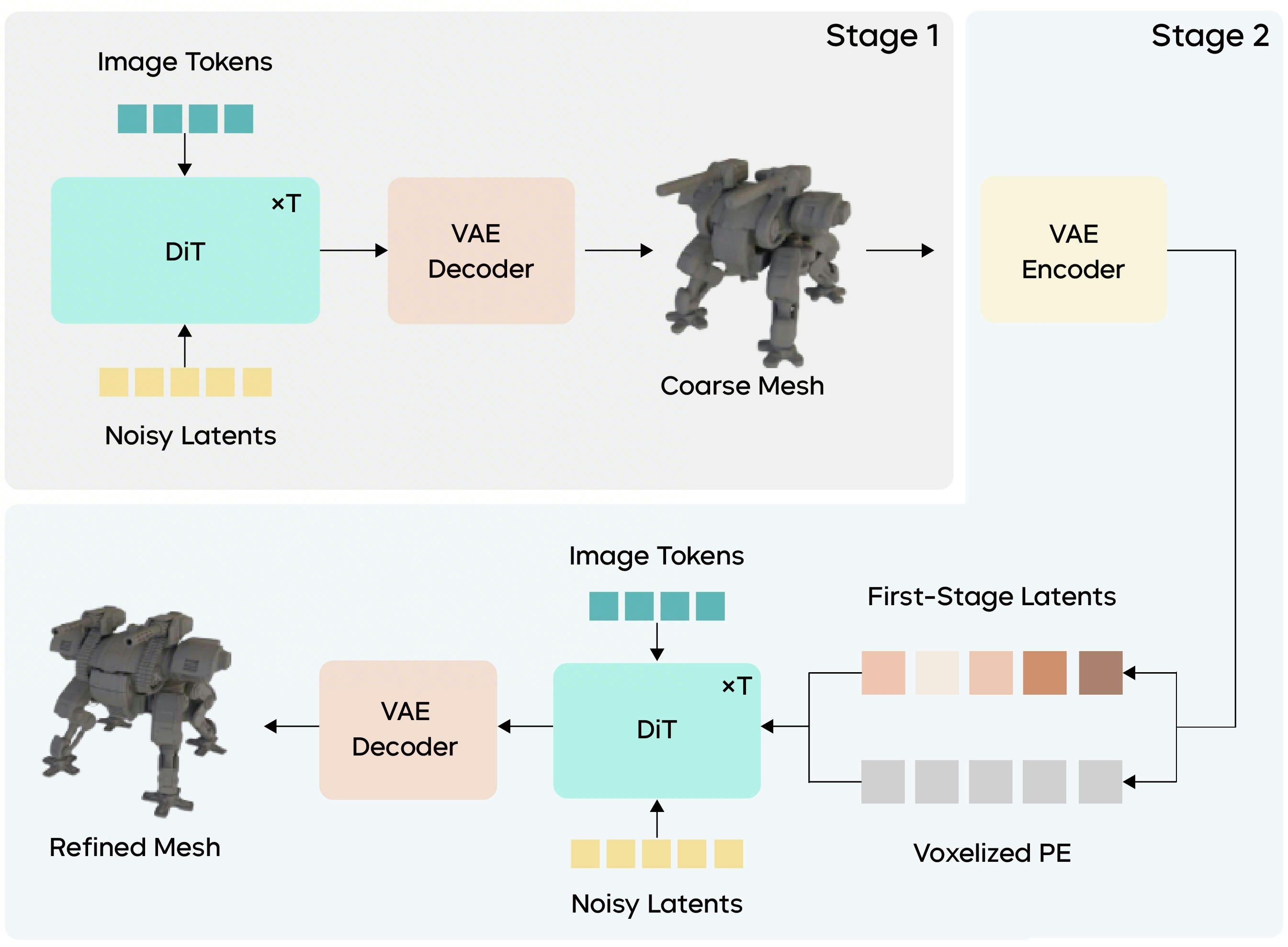

1. 几何生成:引入两阶段 DiT,从结构合理到细节可靠

3D 内容生成的几何和纹理质量,是决定模型可用性的两大核心维度。其中,几何质量直接决定了物体结构是否合理,是区分生成内容“可用”与“不可用”的关键分水岭。在 Seed3D 1.0 中,模型需要同时完成“整体结构”和“精细结构”的生成,这种方式虽能较快捕获物体整体形状,但在锐利边缘和精细结构上可能存在“软化”现象,导致生成的边不够笔直、曲面不够精准。

Seed3D 2.0 几何生成的完整流程

Seed3D 2.0 的改进思路是,引入 Coarse-to-Fine 两阶段生成策略,把“整体结构”和“几何细节”解耦,分开优化,从而在锐利边缘、薄壁结构和复杂拓扑等几何生成难点上取得突破:

阶段一:粗糙几何结构生成。模型利用更大参数规模的 DiT,基于输入图像生成粗粒度的几何结构,建立整体的拓扑关系和空间布局。

阶段二:高精度细节生成。模型以阶段一的输出作为几何锚点,专注于锐利边缘、精细表面等细节恢复,其中引入两种关键先验:

局部感知先验:将第一阶段的粗糙结果转化为隐变量,为后续的细节生成提供可靠的初始化输入,避免“凭空生成”带来的不稳定。

体素化位置编码:在第一阶段生成的几何表面采点,并进行体素化处理,作为位置编码为模型提供空间位置约束。

此外,Seed3D 2.0 在 VAE 侧做了同步升级,更少 token 即可获得更高的重建精度。通过增强局部区域的细节表达,并根据内容动态分配注意力,我们大幅提升了 VAE 模型的重建精度和推理效率。

如下图所示,与现有主流 3D 生成模型的定性对比表明,Seed3D 2.0 在处理复杂结构的精细边缘、生成薄壁结构和还原输入图像方面明显优于基线方法。

几何生成维度的定性对比

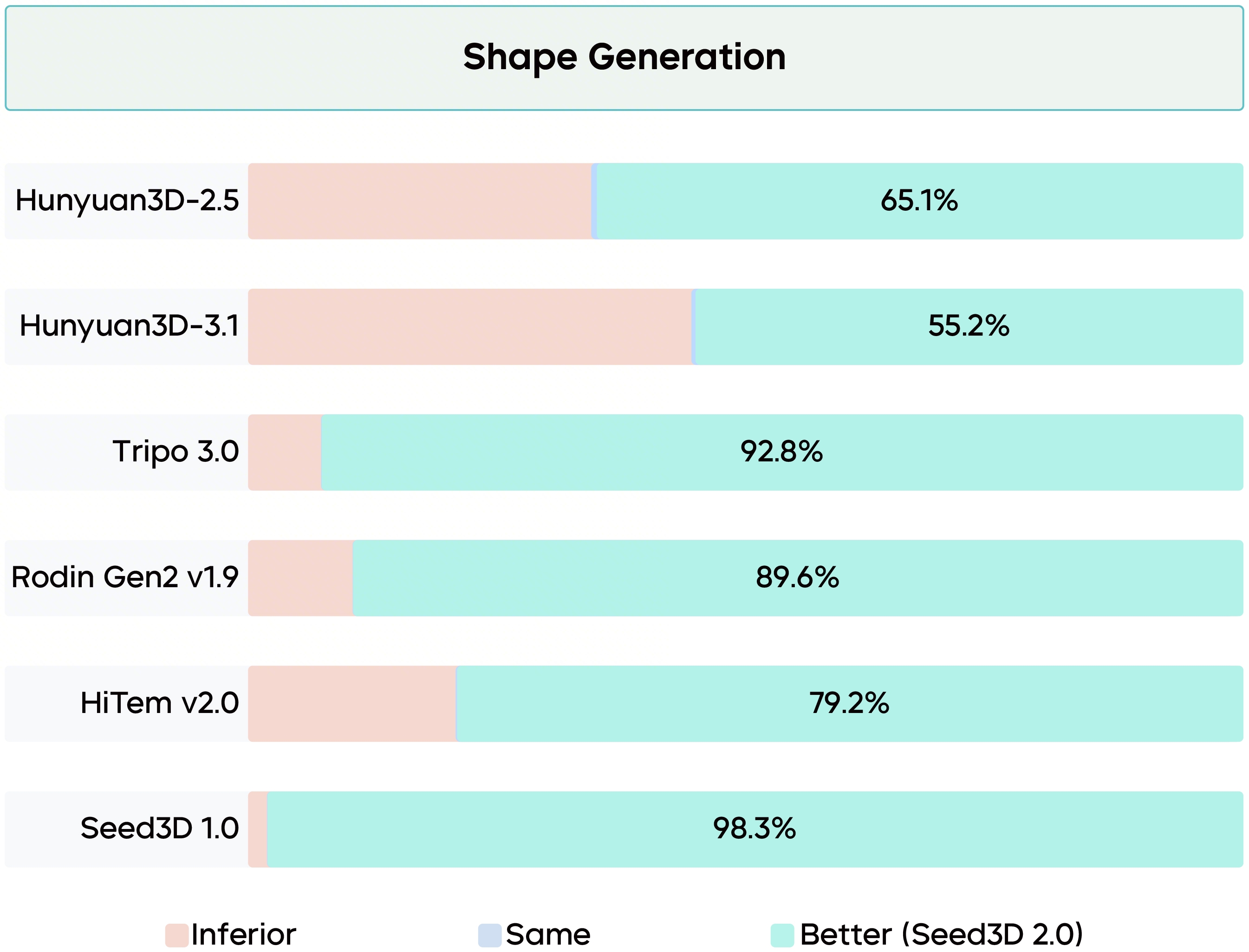

此外,我们招募了 60 位具有 3D 建模经验的人类打分员,针对约 200 个测试用例,对 Seed3D 2.0 和六个主流模型的生成质量进行两两盲评对比。Seed3D 2.0 在几何形状生成的对比测试中展现出显著优势,相比所有其他 3D 生成模型呈现更高的偏好率(人类打分员认为其生成质量更优的比例),验证了架构创新带来的几何质量提升。

在纯几何生成任务中,用户认为 Seed3D 2.0 相比主流模型更优的比例

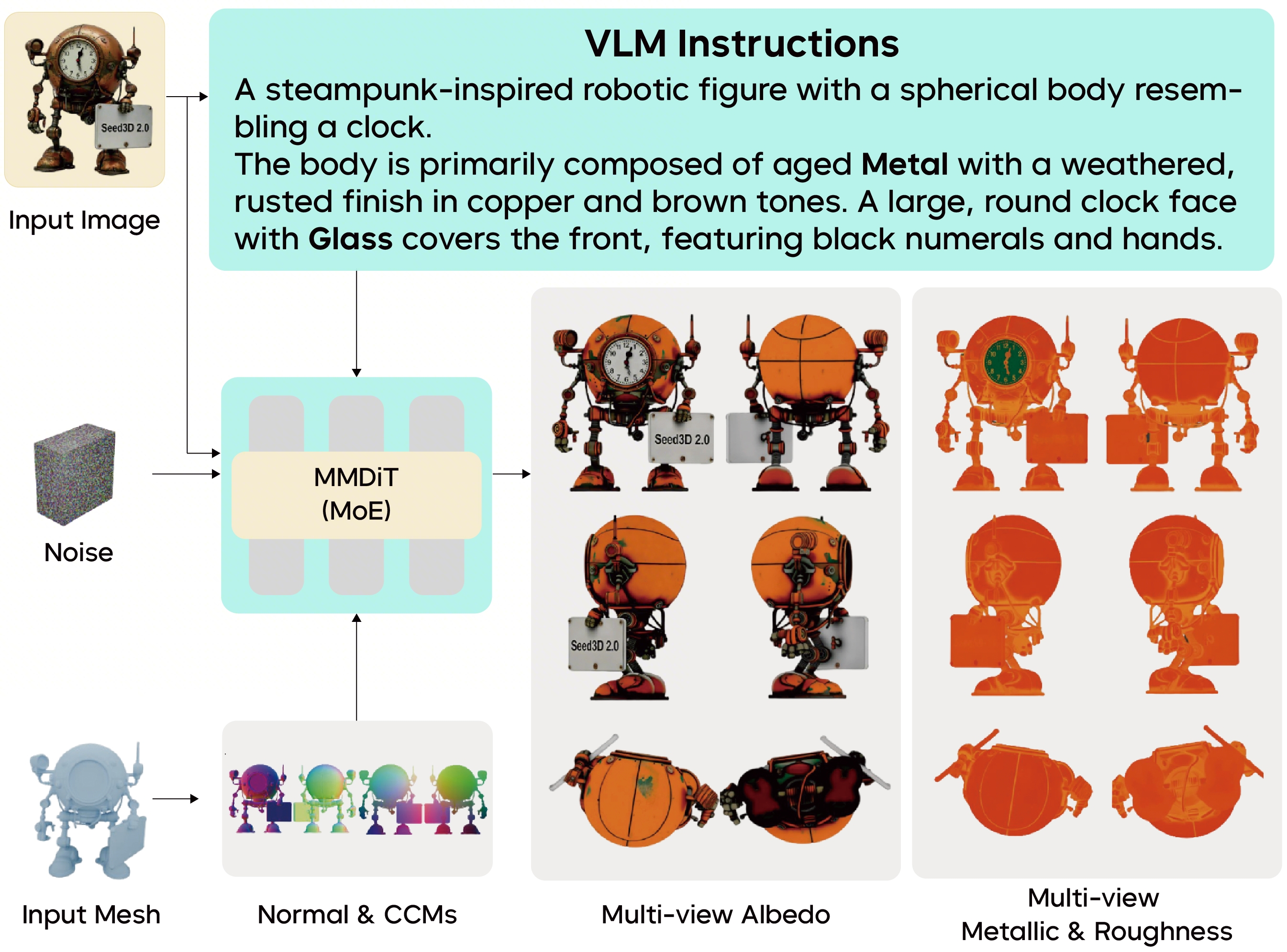

2. 纹理生成:统一 PBR 模型,从外观相似到物理一致

除了几何结构的精度,纹理材质的真实感也直接决定了 3D 内容的质量。尤其是在下游应用中,仅有 RGB 外观远远不够,完整的 PBR 材质才能确保 3D 内容在任意光照条件下保持物理一致的视觉效果。

Seed3D 1.0 采用了级联式模型进行 RGB 生成和 PBR 分解,中间步骤的误差会逐级累积,影响最终材质质量。在 Seed3D 2.0 中,我们将其简化为统一的 PBR 生成模型,保持 MMDiT 双流架构,通过模态特定投影层,即可在共享 DiT 层中联合建模完整 PBR 贴图。

Seed3D 2.0 的纹理生成流程

我们在统一的生成架构基础上,还引入两项关键创新,实现了更高分辨率下的精准材质生成:

采用 MoE 架构,提升高分辨率材质的细节与边界精度。Seed3D 1.0 受限于输出分辨率,难以保留材质分解中的细节,而直接扩大模型参数量和分辨率的计算开销过高。因此我们采用 MoE 架构,通过稀疏专家路由,在扩大模型参数量和分辨率的同时控制推理计算量,使模型能生成更丰富的纹理细节和更精确的金属-粗糙度边界。

引入 VLM 先验,增强未知光照下的材质分解稳定性与准确性。从 RGB 图像逆向推导 PBR 材质是一个行业难题:相同的外观,可能由不同的材质与光照组合产生,模型推理时经常出现色偏、金属性误判等错误。为此,我们引入 VLM 模型对输入图片的材质类型和物理属性进行描述,并作为额外控制信号注入 DiT 中,让材质分解更加稳定且合理。

纹理材质生成的定性对比中,Seed3D 2.0 在生成真实度、材质质量、视觉细节和文字渲染等维度上均优于基线方法。

例如,在不锈钢锅这一物体上,Seed3D 2.0 的生成结果呈现出更接近真实的金属质感:表面反射具有一定粗糙度变化,并伴随轻微使用痕迹,高光分布自然,不同部位之间的材质表现保持一致。相比之下,其他方法易出现材质过于均匀或整体偏暗的情况,缺乏真实物体中的细微变化。

纹理生成维度的定性对比

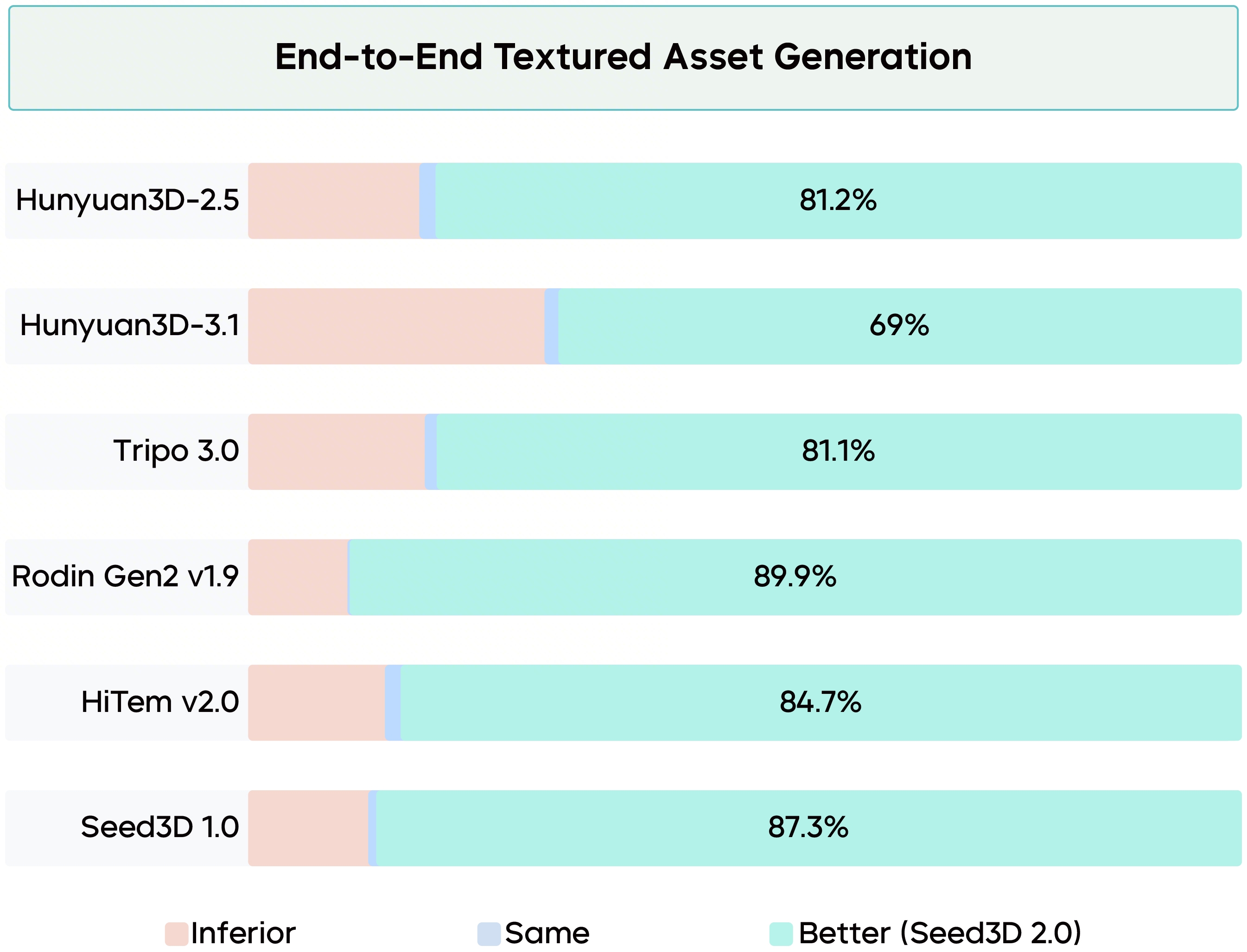

在纹理 3D 内容生成的人类打分中,Seed3D 2.0 同样领先其他基线方法,面对目前行业内主流模型,Seed3D 2.0 的偏好率达到 69% 以上。

在纹理生成任务中,用户认为 Seed3D 2.0 相比其他基线模型更优的比例

3. Seed3D 2.0 下游任务探索:部件级生成与场景组合

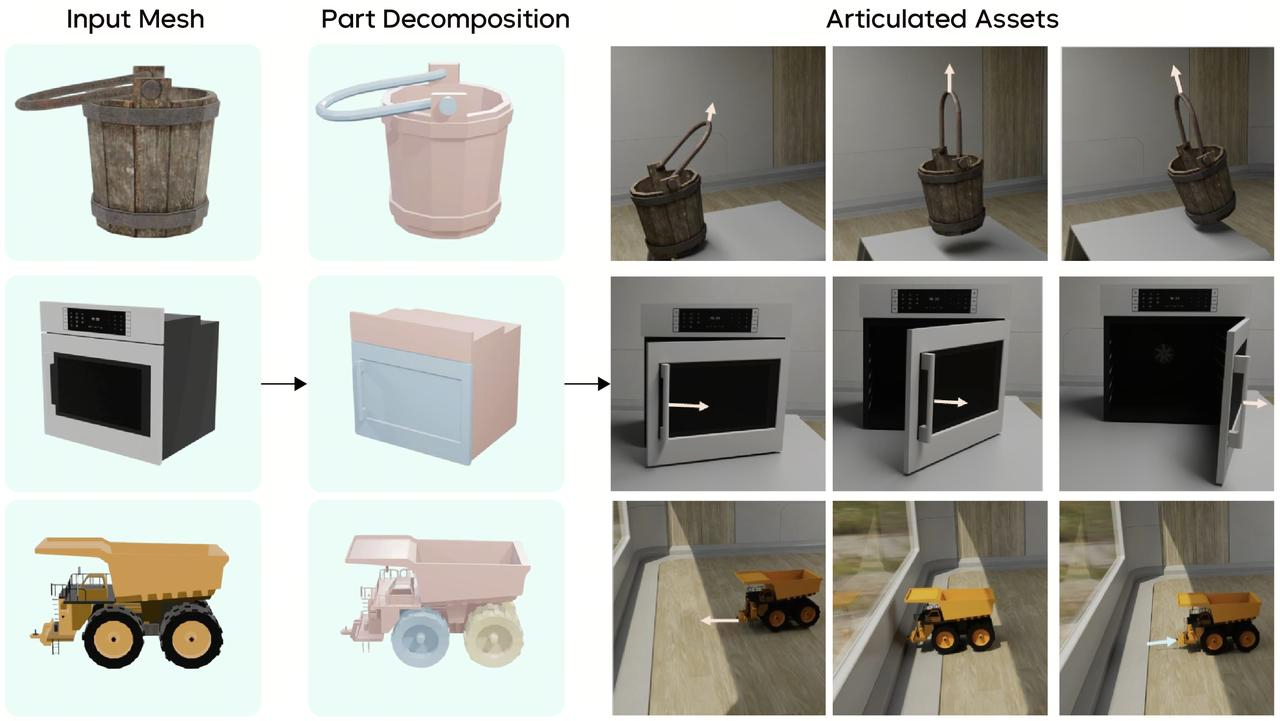

在许多下游场景中,完整的 3D 物体需被拆解为功能性部件,例如在交互式系统中需要可独立操控的物体组件,仿真环境中需要可关节化运动的部件结构。因此,Seed3D 2.0 进一步拓展了建模的灵活性,可实现组成部件“分合自如”。

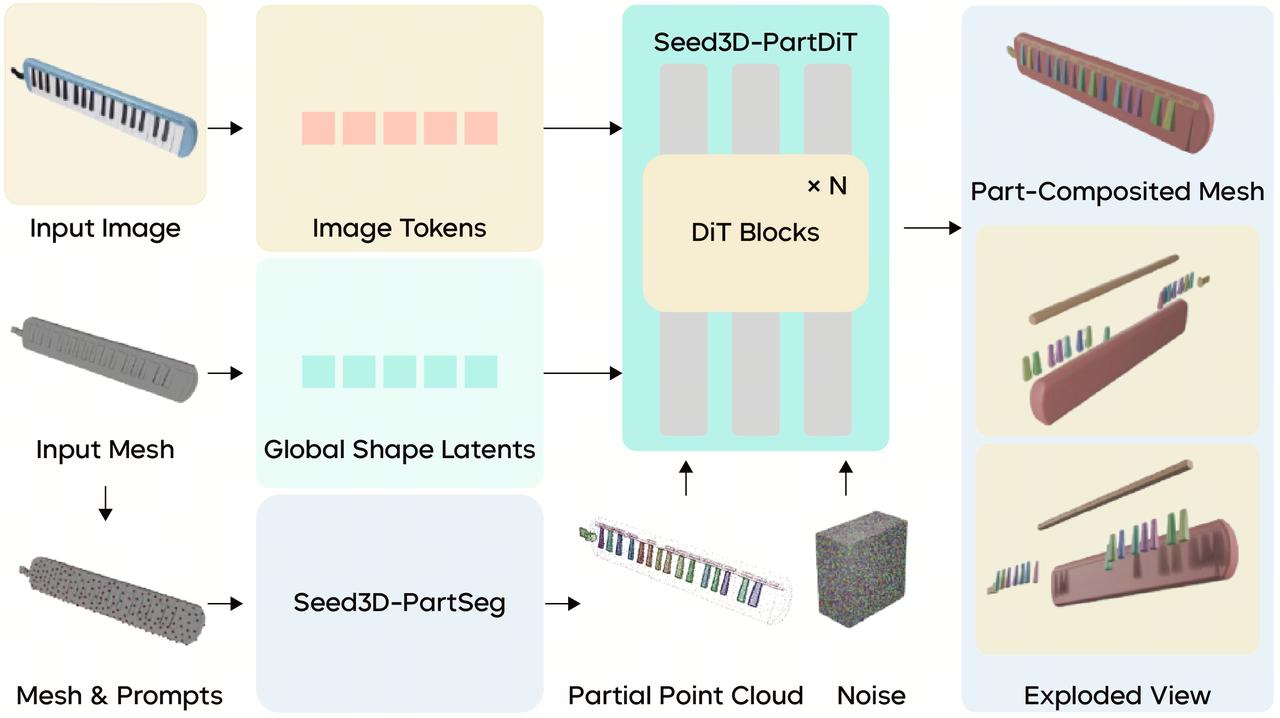

部件级 3D 内容生成流程概览

Seed3D 2.0 采用“先理解,再生成”的范式,将复杂的部件生成流程分解成两步:对生成的 3D 内容先进行部件级的拆分,然后补全每个部件的完整形状。

首先,Seed3D 2.0 通过收集和标注大量特定的分割数据,来学习如何在 3D 数据上根据功能性等维度进行拆分。我们训练了 Seed3D-PartSeg 的 3D 理解模块,可对完整 3D 网格进行表面分割。在此基础上,Seed3D-PartDiT 进一步以全局 3D 形状、分割点云和图像为输入,训练生成网络,最终把表面拆分结果补全并组合为完整的部件化网格。

如下图所示,一把椅子会被模型自动拆分为座椅、靠背和底座;机器人也被按照四肢等部位精细拆解。这种部件尺度下的表征,为后续的精细交互操作提供了基础。

独立的部件需要正确的物理连接才能产生有意义的交互。因此在部件分割的基础上,Seed3D 2.0 进一步引入了关节化建模能力。

这一过程融合了多模态理解与生成技术。模型首先利用 VLM 把部件拆分为运动学组件,并识别关节类型(如“可旋转部件”或“固定结构”),再结合几何先验估计关节轴位置。为确保运动的物理合理性,模型还引入图生视频模型生成运动参考,以优化关节部件的运动范围,最终模型可输出带有完整关节信息、以 URDF 等标准格式呈现的 3D 内容,实现与 Isaac Sim 等主流物理仿真引擎的兼容。

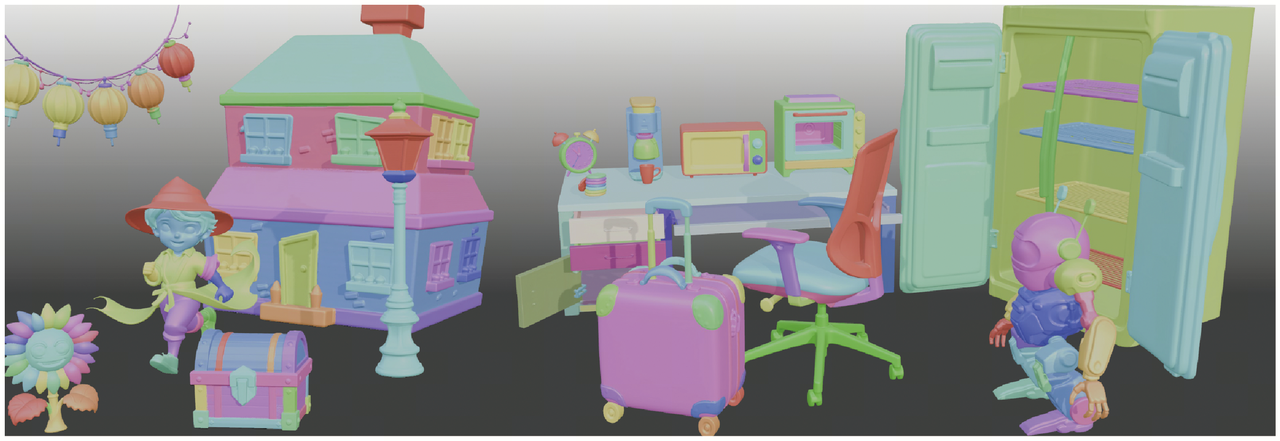

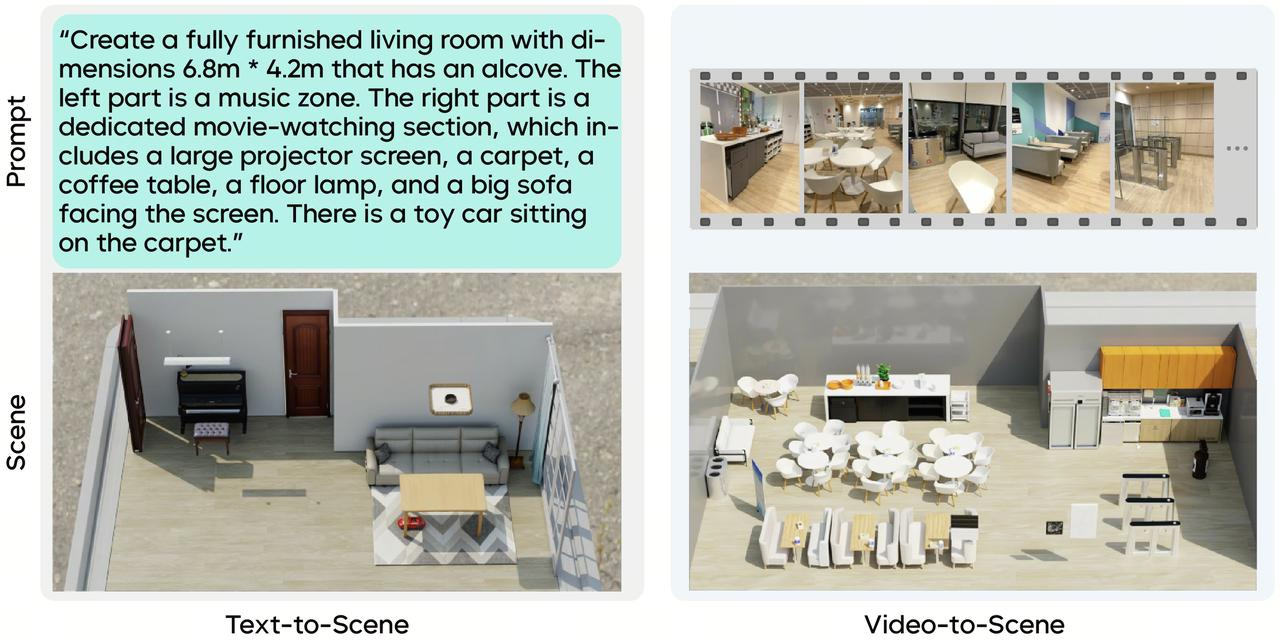

真实的物理世界是由众多物体交织而成的,因此,Seed3D 2.0 还将单一物体生成能力拓展至场景生成。

为实现合理的对象排列,Seed3D 2.0 选择根据不同的输入条件智能适配布局策略:对于文本输入,利用微调过的 LLM 进行空间关系推理和布局生成;对于多视角图片或视频输入,模型额外利用深度估计等视觉信号,以及实例分割和遮挡修复等能力,来推理场景空间布局。获取布局后,Seed3D 2.0 可以逐个生成 3D 内容,并按照空间关系进行组合,构建丰富且完整的场景。

Seed3D 2.0 的仿真场景生成流程

更进一步,结合前述的部件级生成与关节化能力,Seed3D 2.0 最终生成的场景不仅具有严谨的空间结构,其中的物体还可以被转化为支持物理交互的关节化 3D 内容,为下游的物理仿真场景奠定了基础。

4. 总结与展望

Seed3D 2.0 在几何精度、PBR 材质质量以及下游可用性方面取得了显著进展。不过,3D 生成仍然面临一系列长期挑战:几何生成的精细度与泛化性尚有提升空间;纹理生成还存在遮挡与贴图误差问题;3D 生成模型的大规模应用受限于推理效率;3D 生成模型的落地场景还存在未知与探索空间。未来,我们会在这些方向上继续攻坚,推动 3D 生成技术在更多场景中规模化应用。